Свежие публикации

При её использовании директору не нужно относить в ФНС бумажную доверенность, а ИП не требуется заверять её нотариально.

Экспертиза товара ненадлежащего качества, сроки проведения которого регулируется законом, позволяет определить причину возникновения дефекта.

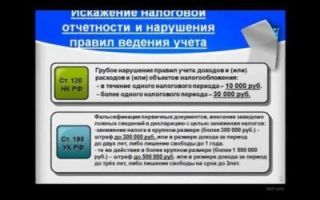

Президент подписал закон о внесении изменений в КоАП.

Вопрос ответственности работодателя за неоформленного работника – актуален как для граждан, так и для иностранного персонала.

Совершенствуйте предпринимательские навыки и личностные качества, необходимые для успешного роста.

Предлагает условия оферент, а принимает их акцептант.

Показать ещё

Популярные публикации